Apple がエコシステム内のデバイスを通過するデータの機密性を非常に重視しており、覗き見から十分に保護されていることは知られています。ただし、ユーザーが倫理、道徳、さらには人間性に関するルールに従う必要がないという意味ではありません。

Appleは、ユーザーが保存したすべての画像をスキャンできるテクノロジーを間もなくリリースすると発表しました。 iCloud 子どもに対する性的虐待を含む写真を特定します。児童性的虐待資料 (CSAM)。

このテクノロジーは、Apple によって今年末に向けて、限られた数のユーザー向けにパイロット版としてリリースされる予定です。

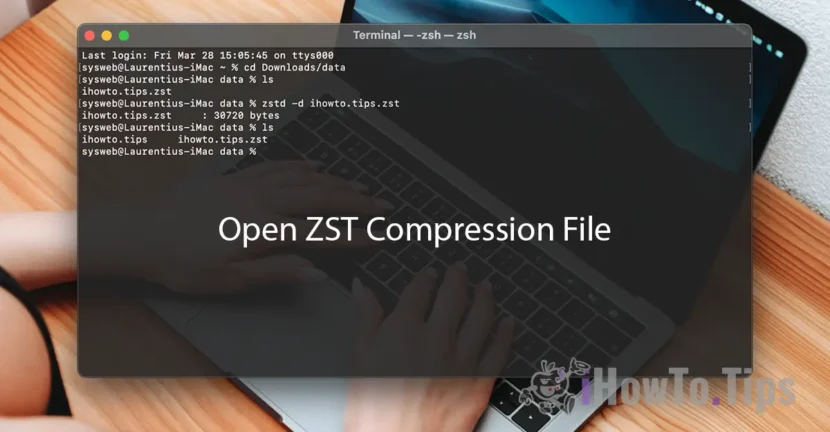

「データの機密性はどこにあるのか?」と自問するなら、私たちが受け取るものはすべてコンテンツであることがわかります。 ビデオ/写真 これは暗号化されたプロトコルを通じて行われます。同様に、iCloud のデータ ストレージは暗号化されますが、データ暗号化キーはそのようなサービスのプロバイダーが保持します。ここで私たちは Apple についてだけ話しているわけではありません。 Microsoft、Google、その他のクラウド データ ストレージ サービスも同様です。

保存されたデータは、法的措置で要求された場合、または著しく法律に違反した場合に、復号化して検証することができます。子供や女性に対する暴力行為など。

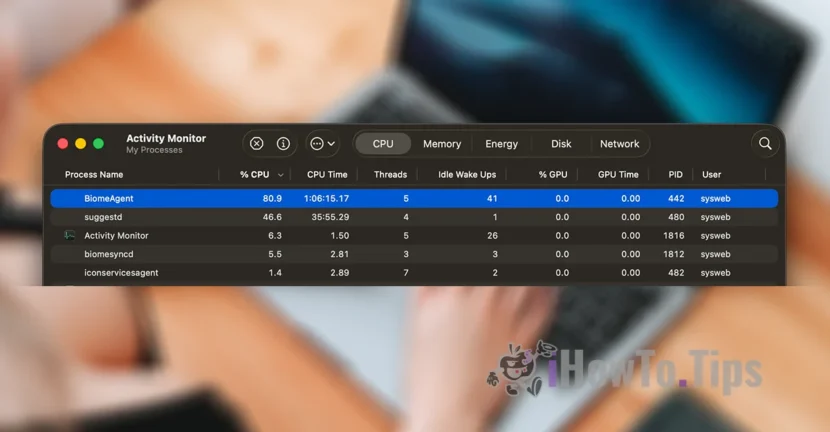

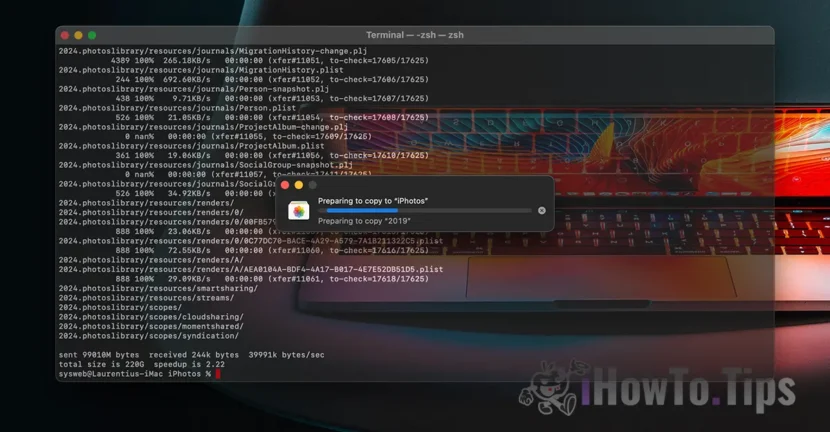

ユーザーのプライバシーを保護するために、同社は NeuralHash と呼ばれる新しいテクノロジーを利用しています。このテクノロジーは、iCloud の写真をスキャンし、データベース内の他の画像と比較することで、子供に対する暴力を含む写真を特定します。

これは、顔認識や物体、動物、その他の要素のインテリジェント認識に似ています。

この技術により、iPhone、iPad、または Mac デバイスを介して撮影または転送された写真が変更されている場合でも、スキャンして検証できるようになります。