Se sabe que Apple se preocupa mucho por la confidencialidad de los datos que pasan por los dispositivos del ecosistema y que estén bien protegidos de miradas indiscretas. Sin embargo, no significa que los usuarios no tengan que obedecer reglas relacionadas con la ética, la moral y por qué no, la humanidad.

Apple ha anunciado que pronto lanzará una tecnología capaz de escanear todas las imágenes almacenadas por los usuarios en el icloud e identificar fotografías que contengan abuso sexual contra niños. Material de abuso sexual infantil (CSAM).

Apple lanzará esta tecnología a finales de este año, probablemente en una versión piloto, para un número limitado de usuarios.

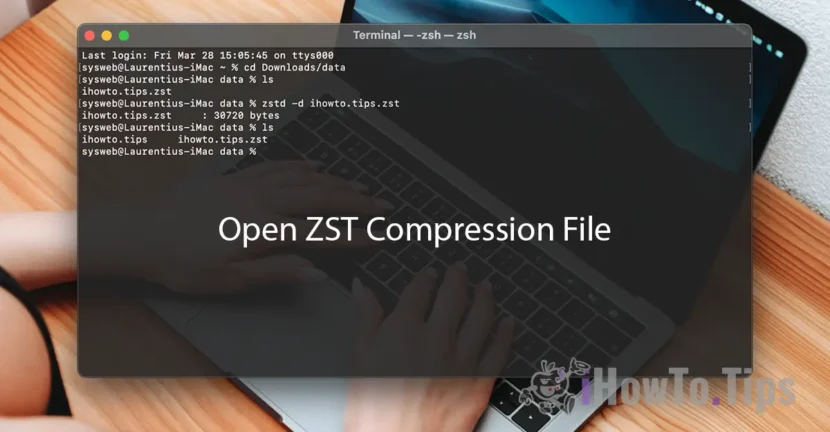

Si te preguntas “¿dónde queda la confidencialidad de los datos?”, descubre que todo lo que recibimos es contenido vídeos/fotos se realiza a través de un protocolo cifrado. Del mismo modo, el almacenamiento de datos en iCloud está cifrado, pero los proveedores de dichos servicios poseen la clave de cifrado de datos. Aquí no hablamos sólo de Apple. Microsoft, Google y otros servicios de almacenamiento de datos en la nube hacen lo mismo.

Los datos almacenados pueden ser descifrados y verificados si se solicitan en una acción legal o si violan flagrantemente las leyes. Como los relativos a actos de violencia contra niños y mujeres.

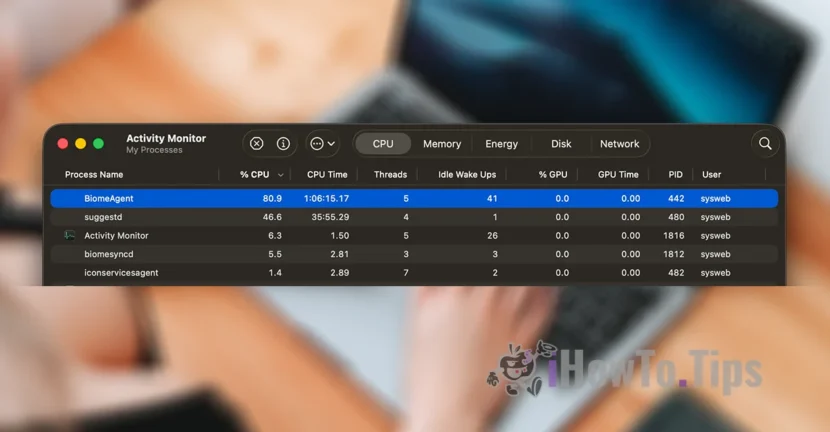

Para preservar la privacidad de los usuarios, la empresa confía en una nueva tecnología, llamada NeuralHash, que escaneará fotos de iCloud e identificará aquellas que contengan violencia contra niños, comparándolas con otras imágenes en una base de datos.

Es algo parecido al reconocimiento facial o reconocimiento inteligente de objetos, animales y otros elementos.

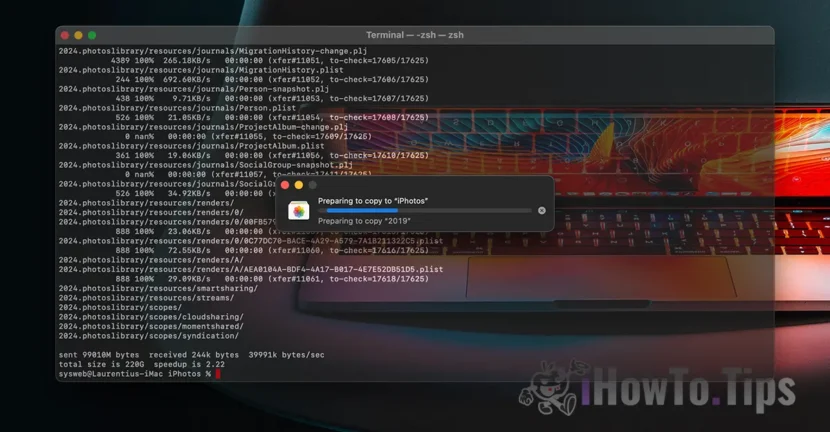

La tecnología podrá escanear y verificar las fotografías tomadas o transferidas a través de un dispositivo iPhone, iPad o Mac, incluso si sufrirán cambios.