Je známo, že Apple velmi dbá na důvěrnost dat, která procházejí zařízeními v ekosystému a jsou dobře chráněna před zvědavými pohledy. Neznamená to však, že se uživatelé nemusejí řídit pravidly souvisejícími s etikou, morálkou a proč ne, lidskostí.

Apple oznámil, že brzy uvede technologii schopnou skenovat všechny obrázky uložené uživateli iCloud a identifikovat fotografie, které obsahují sexuální zneužívání dětí. Materiál pro sexuální zneužívání dětí (CSAM).

Tuto technologii spustí Apple koncem letošního roku, pravděpodobně v pilotní verzi, pro omezený počet uživatelů.

Pokud se sami sebe ptáte „kde je důvěrnost dat?“, zjistěte, že vše, co dostáváme, je obsah videa/fotky provádí se pomocí šifrovaného protokolu. Stejně tak úložiště dat na iCloudu je šifrováno, ale poskytovatelé takových služeb drží klíč pro šifrování dat. Zde nemluvíme pouze o Apple. Microsoft, Google a další cloudové služby pro ukládání dat dělají totéž.

Uložená data mohou být dešifrována a ověřena, pokud jsou požadována v rámci právního jednání nebo pokud zjevně porušují zákony. Například ty, které se týkají násilných činů na dětech a ženách.

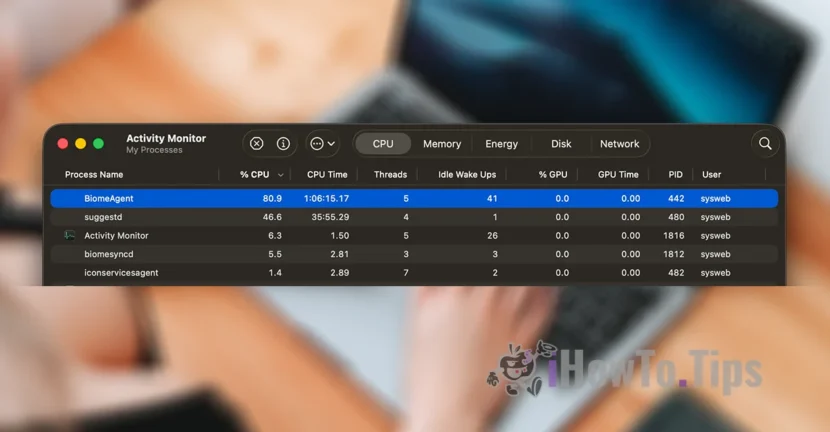

Pro zachování soukromí uživatelů společnost spoléhá na novou technologii nazvanou NeuralHash, která bude skenovat fotografie na iCloudu a identifikuje ty, které obsahují násilí na dětech, jejich porovnáním s jinými obrázky v databázi.

Je to trochu podobné rozpoznávání obličeje nebo inteligentnímu rozpoznávání předmětů, zvířat a dalších prvků.

Tato technologie bude schopna skenovat a ověřovat snímky pořízené nebo přenesené prostřednictvím zařízení iPhone, iPad nebo Mac, i když projdou změnami.